로봇의 원칙은 아래와 같다.

제1원칙, "로봇은 인간에게 해를 입혀서는 안 된다. 그리고 위험에 처한 인간을 모른 척해서도 안 된다."

제2원칙, "제1원칙에 위배되지 않는 한, 로봇은 인간의 명령에 복종해야 한다."

제3원칙, "제1원칙과 제2원칙에 위배되지 않는 한, 로봇은 로봇 자신을 지켜야 한다."

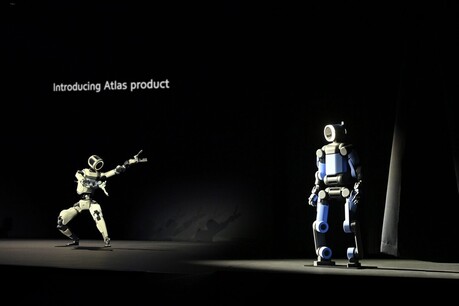

산업, 가정, 의료, 교육, 일상생활까지. 오늘날 로봇이 인간에게 주는 혜택은 무궁무진하다. 하지만 명암의 차이를 보듯 로봇의 윤리적 규칙이 정해지지 않는다면, 그 혜택은 피해가 될 것이다.

이번 시간에는 로봇, 윤리 첫걸음이라는 주제로 로봇의 윤리 생성 과정을 간단히 정리할 것이다.

로봇 윤리란?

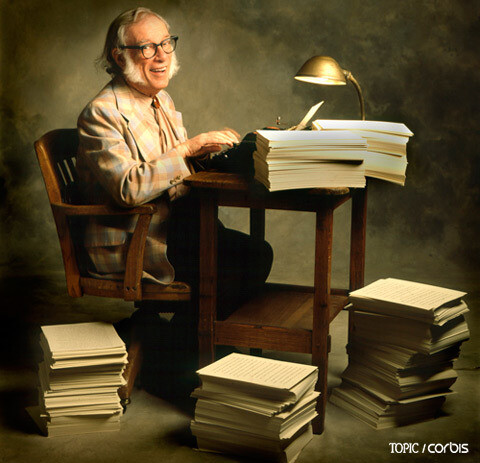

로봇윤리을 최초로 언급한 학자는 아이작 아시모프(Isaak Asimov)이다. 아시모프는 그의 저서 'I'Robot'(1950)에는 '로봇 윤리의 3요소'를, '로봇과 제국'(1985)에서는 '제로 법칙'을 추가했다.

제로 법칙은 "로봇은 인류에게 해를 가하거나, 행동을 하지 않음으로써 인류에게 해가 가도록 해서는 안 된다"는 내용을 담고 있다.

이후 로봇 윤리 관련 법칙이 지속해서 생겨나고, 발전했다. 두 가지 예시를 보자.

[일본의 가전제품 3원칙]

제1조. 위험하지 않을 것

제2조. 사용하기 편할 것

제3조. 튼튼할 것

[전투로봇 3원칙]

제1조. 전투 로봇은 아군에게 위해를 가할 수 없지만, 적군은 죽일 수 있다.

제2조. 전투 로봇은 아군의 명령에 따라야 한다. 명령이 1조에 어긋날 때는 따르지 않아도 된다.

제3조. 전투 로봇은 1조와 2조에 위배되지 않는 한 자신을 지켜야만 한다.

이처럼 로봇은 특정한 규칙에 의해 인간의 후생(厚生)을 위해 존재한다.

로봇 윤리가 존재하지 않는다면?

로봇 윤리가 존재하지 않는다면 어떻게 될까?

먼저, 로봇이 직접적으로 인간에게 해를 끼칠 것이다. 로봇이 인간을 공격하고 살해할 수 있다. 또한, 자유의식을 가진 로봇이 생겨난 이후 로봇이 인간에 대항하여 인간과 로봇 간 전쟁이 있을 수도 있다.

오늘날 로봇은 인간에게 필수요소로 자리 잡았다. 더 높은 발전과 화합을 위하여 로봇 윤리는 지속해서 필요하며 로봇 윤리는 그 해답이 될 것이다.

[저작권자ⓒ CWN(CHANGE WITH NEWS). 무단전재-재배포 금지]

![[구혜영 칼럼] 사회복지교육은 미래복지의 나침반이 되어야](/news/data/2026/01/16/p1065596364370517_157_h.png)