개인 정보의 노출이 민감한 현대 사회에 이르면서 본인 인증을 위한 다양한 기술이 개발되고 있다. 이제 숫자, 문자 그리고 특수 문자로 된 비밀번호는 안전을 보장하지 못하고, 철저한 보안을 위해 매번 바꿔줘야 하는 번거로움이 있다.

인공지능이 발전하면서, 최근에는 자신의 얼굴이 곧 비밀번호로 사용되는 추세이다. 스마트폰 잠금장치, 은행 애플리케이션의 본인 확인, 공항의 출입국 관리 시스템 그리고 대학교 출석 관리 시스템 등 수많은 곳에서 사용되고 있다.

안면 정보는 다른 분야에서도 많이 사용된다. SNS에 올라오는 친구들의 사진들을 보면 ‘사진 빨’이라는 말이 떠오른다. 요즘 가장 인기 카메라 앱인 네이버의 ‘스노우(SNOW)’, 그리고 카카오의 ‘카카오치즈’, 중국 바이두의 ‘메이투‘ 등은 카메라에 비친 자신의 모습을 보정하거나 성형하는 기능을 한다.

이처럼 얼굴 정보를 사용하고 가공하는 기술의 중심에는 딥러닝을 통한 안면 인식 기술이 있다. 그렇다면 얼굴 인식은 어떻게 이루어지는 것일까? 카메라에 비친 얼굴의 어떤 정보를 가져다 사용하는 것일까? 사람이 눈을 통해 사람을 보고 뇌에서 사람을 구별하는 것처럼, 안면 인식 기술도 여러 단계를 거쳐 이루어진다.

1. 영상 또는 이미지에서 얼굴 찾기

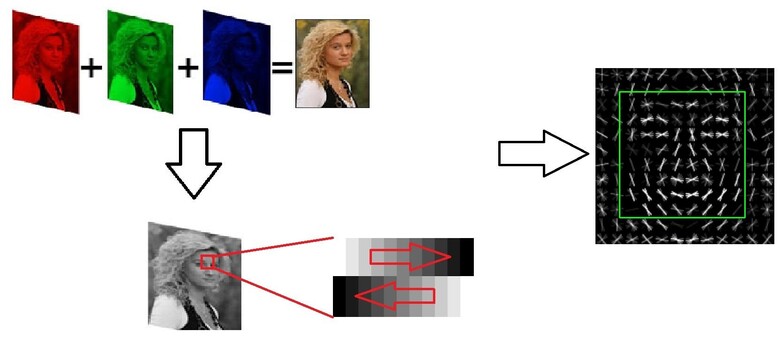

우선, 카메라에 입력된 데이터(사진 또는 영상)에서 얼굴을 찾기 위해 데이터를 컬러에서 흑백으로 변환한다. 사진의 명암 정보를 사용하기 위한 목적이다. 컬러 사진의 경우 이미지는 RGB(빨강, 초록, 파랑)인 3개의 채널로 표시되지만, 흑백 이미지는 한 층의 채널로 표현이 가능하다.

흑백 이미지의 픽셀을 확대해보면, 인접한 픽셀의 명암이 달라서 층이 보인다. 이때, 화살표로 밝은 픽셀에서 어두운 픽셀 방향으로 화살표를 만들어 조합한 그래디언트 패턴(Gradient Pattern)을 이용해, 컴퓨터가 데이터에서 얼굴을 특정해 낼 수 있게 된다.

2. 얼굴에서 특징 찾기

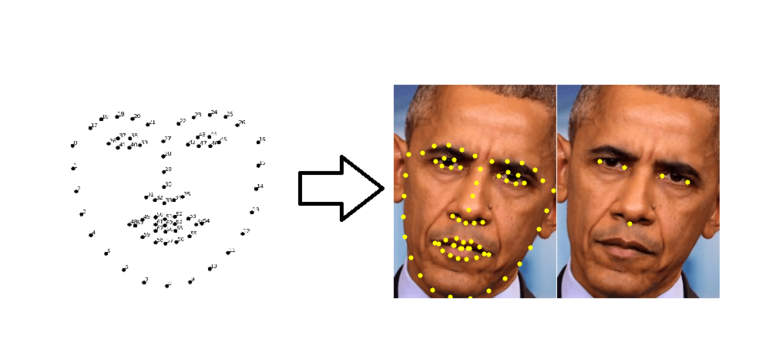

사진을 보고 사람의 얼굴 위치를 찾을 수 있게 된다면, 다음에는 누구의 얼굴인지 구별해 낼 수 있어야 한다. 우리는 사람의 얼굴을 생김새 즉, 이목구비의 위치와 모양을 통해 구분한다.

이처럼 기계도 사람의 얼굴을 구분하기 위해서는 눈, 코, 입, 얼굴 선, 눈썹 등 사람의 얼굴 특징을 구분할 수 있는 기준점을 찾아야 한다. 앞에서 구한 패턴을 활용해 기준점들 구할 수 있으며, 기준점의 개수는 마음대로 설정할 수 있다.

딥러닝을 통해 모델을 학습하게 되면, 그 과정에서 더 나은 안면 인식 기능을 구현하기 위해 기준점의 개수를 늘렸다가 줄였다가 하는 과정을 반복하게 된다. 주로 68개의 기준점이 가장 적절하다고 판단한다.

3. 얼굴을 서버에 저장하기

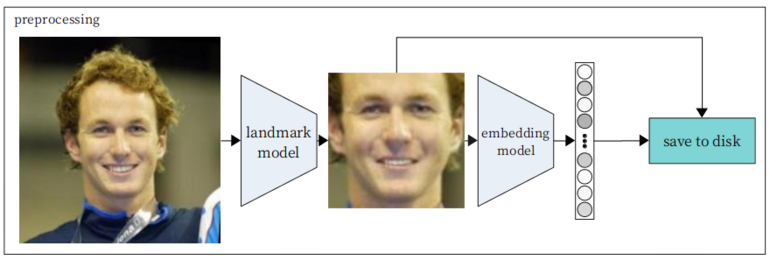

사진 혹은 영상 속 인물의 얼굴 특징까지 확인했다면, 기계가 입력된 사진에서 얼굴 영역을 찾고, 특정 인물의 정보를 추출할 수 있게 된다. 입력된 사람의 얼굴에서 특징을 추출한 뒤, 임베딩(embedding)이라는 과정을 거쳐서 특징들을 일련의 벡터로 실수화한다. 실수화된 데이터는 사람의 이름과 함께 서버에 저장이 되며, 이제 해당 사람의 얼굴을 식별할 준비가 마쳐진다.

4. 사용하기

카메라에 얼굴이 비치면, 사진에서 사람의 얼굴 영역과 특징을 찾고 임베딩 값을 구해서 서버에 저장된 값과 비교해 누구인지를 구분할 수 있게 된다.

안면 인식 기술 분야에서 선두를 차지하고 있는 중국은 이를 적극적으로 활용하면서 다양한 서비스를 제공하고 있다. 일례로 안면 인식 결제를 통해 어디서든 얼굴을 비추면 결제가 완료된다. 또, 안면 인식 기술을 적용한 슈퍼 카메라를 이용해 도시 상공에서 수만 명의 얼굴을 동시에 인식해, 범죄자를 색출하기도 한다. 안면 인식 기술은 현재도 발전하고 있으며, 앞으로도 무궁무진한 가능성을 열어두고 있다.

[저작권자ⓒ CWN(CHANGE WITH NEWS). 무단전재-재배포 금지]

![[구혜영 칼럼] 사회복지교육은 미래복지의 나침반이 되어야](/news/data/2026/01/16/p1065596364370517_157_h.png)